慢SQL问题已成为影响计算机数据处理服务性能与稳定性的关键瓶颈之一,它不仅降低系统响应速度,还可能导致资源浪费、用户体验下降,甚至引发服务中断。科学地破解慢SQL,需要从诊断、分析到优化实施形成一套系统化、可落地的解决方案。

一、 系统性诊断:定位问题根源

破解慢SQL的第一步是精准定位。盲目优化往往事倍功半。科学诊断应包含以下环节:

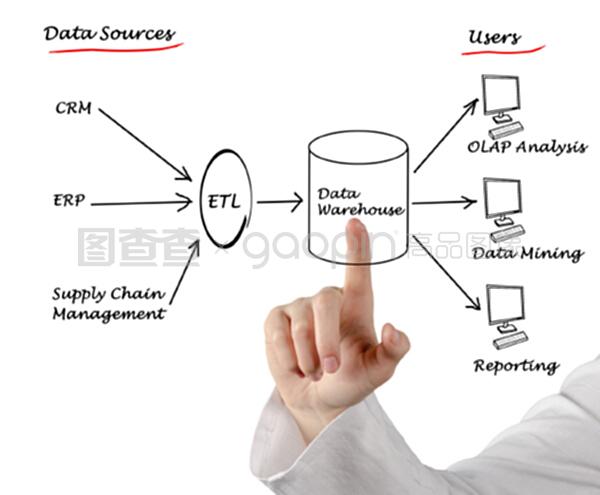

- 监控与发现:建立完善的数据库监控体系,利用慢查询日志(如MySQL的slowquerylog)、性能监控工具(如Prometheus+Grafana,或云服务商提供的RDS监控)或APM(应用性能管理)工具,持续捕获执行时间超过阈值的SQL语句及相关上下文(执行时间、锁等待时间、扫描行数、返回行数等)。

- 关键指标分析:聚焦核心性能指标:

- 执行时间:最直观的慢速体现。

- 扫描行数与返回行数比:比值过大常意味着索引失效或缺失,导致大量无效I/O。

- 锁等待时间:高并发下的锁竞争(如行锁、表锁)会显著拖慢速度。

- 执行计划(Explain/Analyze):这是诊断的“金标准”。通过解析执行计划,可以清晰地看到SQL是如何被数据库引擎执行的,包括访问类型(全表扫描、索引扫描等)、使用的索引、多表连接的顺序与方式、预估成本等。

二、 深度分析与优化策略

基于诊断结果,针对不同成因采取相应优化策略。

- 索引优化——最有效的利器

- 创建缺失索引:针对WHERE子句、JOIN条件、ORDER BY和GROUP BY中的列,创建合适的单列或复合索引。遵循最左前缀原则。

- 避免索引失效:注意导致索引失效的常见场景,如对索引列进行函数运算、类型转换、使用

!=或<>、OR连接条件(有时可改用UNION)等。

- 优化索引选择性:选择性高的列(唯一值多)作为索引前列更有效。对于区分度低的列(如性别),单独创建索引意义不大。

- 清理冗余索引:定期审查并删除重复、从未使用或低效的索引,减少维护开销。

- SQL语句重写与结构调整

- 简化与拆分:避免过于复杂的嵌套查询或超大SQL。可将复杂查询拆分为多个简单步骤,或使用临时表/公共表表达式(CTE)分步处理。

- 优化JOIN操作:确保JOIN字段有索引;小表驱动大表;避免笛卡尔积;检查ON和WHERE条件的有效性。

- 避免

SELECT *:只查询必要的列,减少网络传输和内存开销。

- 善用分页:对于深度分页(如

LIMIT 100000, 20),建议使用基于有序索引的“游标分页”(如WHERE id > last_id LIMIT 20),而非直接OFFSET。

- 减少子查询:许多子查询(尤其是相关子查询)可改写为效率更高的JOIN操作。

- 数据库设计与架构调整

- 范式与反范式的平衡:在遵循数据一致性的前提下,适度反范式化(如增加冗余字段)可以减少JOIN次数,以空间换时间。

- 分区表:对超大型表,按时间、范围或哈希进行分区,可以将查询限定在特定分区,大幅减少数据扫描量。

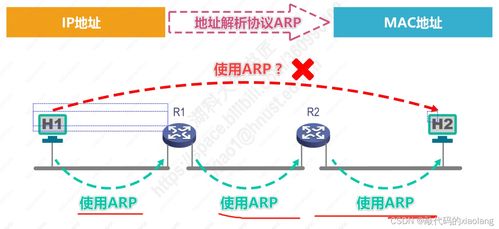

- 读写分离与分库分表:对于超高并发和超大数据量的场景,通过读写分离将读压力分散到多个从库,或通过水平分库分表(如Sharding)分散数据和访问压力。

- 系统与资源配置调优

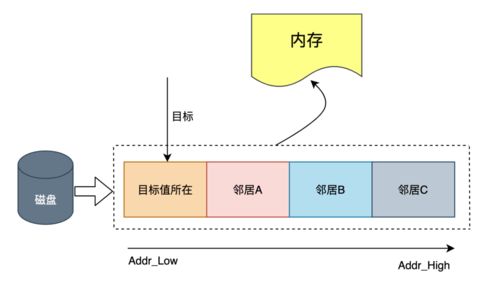

- 数据库参数调优:根据硬件配置和工作负载,调整内存分配(如缓冲池大小、排序缓冲区)、连接数、并发线程数等关键参数。

- 硬件升级:在软件优化达到瓶颈后,考虑升级CPU、内存,或使用更高速的SSD存储。

- 查询缓存与外部缓存:合理利用数据库查询缓存(注意失效策略),并引入Redis、Memcached等外部缓存,将热点、低频变更的查询结果缓存起来,直接减轻数据库压力。

三、 建立长效治理机制

破解慢SQL非一日之功,需融入日常研发运维流程,形成长效机制:

- 左移测试:在开发测试阶段即引入SQL审核工具(如SOAR、SQL Advisor),对代码中的SQL进行静态检查和性能预评估,提前发现问题。

- 持续监控与告警:建立慢SQL实时监控大盘和自动化告警机制,做到问题早发现、早处理。

- 版本与变更管理:对数据库Schema变更和重大SQL上线进行严格评审和性能回测,避免变更引入性能退化。

- 知识沉淀与培训:将典型的慢SQL案例、优化技巧形成知识库,并定期对研发团队进行培训,提升全员的SQL编写和性能意识。

###

科学破解慢SQL是一个结合了技术深度、系统思维和流程规范的综合性工程。它要求数据处理服务团队不仅精通SQL与数据库原理,更要具备从监控、诊断、优化到预防的全链路视角。通过持之以恒地实践上述方法,能够显著提升数据处理服务的效率、稳定性和可扩展性,为业务的高速发展奠定坚实的数据基础。